Sperimentato con successo su un trentenne con una forma avanzata di SLA un sistema che interpreta la capacità del cervello di generare comandi per la comunicazione e li traduce in lettere dell’alfabeto.

I ricercatori del Wyss Center for Bio and Neuroengineering, in collaborazione con l’Università di Tubinga in Germania, hanno permesso a una persona con paralisi completa, che non può parlare, di comunicare tramite un’interfaccia cervello-computer impiantata (BCI).

Sull’uomo, che ha la sclerosi laterale amiotrofica (SLA) – una malattia neurodegenerativa progressiva in cui le persone perdono la capacità di muoversi e parlare – è in corso uno studio clinico, pubblicato su Nature communications, da più di due anni e i risultati mostrano che è possibile far comunicare persone che sono completamente bloccate a causa della SLA.

A livello globale, il numero di persone con SLA è in aumento e si prevede che oltre 300 000 persone vivranno con la malattia entro il 2040, con molti di loro che raggiungeranno uno stato in cui non è più possibile parlare. Con un ulteriore sviluppo, l’approccio descritto in questo studio potrebbe consentire a più persone di mantenere la comunicazione.

”Questo studio dimostra che le persone che hanno perso tutto il controllo muscolare volontario, incluso il movimento degli occhi o della bocca, mantengono la capacità del loro cervello di generare comandi per la comunicazione”, ha detto Jonas Zimmermann, Senior Neuroscientist presso il Wyss Center di Ginevra.

“La comunicazione è stata precedentemente dimostrata con BCI in individui con paralisi. Ma, per quanto ne sappiamo, il nostro è il primo studio su qualcuno che non ha più alcun movimento volontario e quindi per il quale il BCI è ora l’unico mezzo di comunicazione”.

Il partecipante allo studio è un uomo di 30 anni a cui è stata diagnosticata una forma di SLA in rapida progressione. Ha due matrici di microelettrodi intracorticali impiantati chirurgicamente nella sua corteccia motoria.

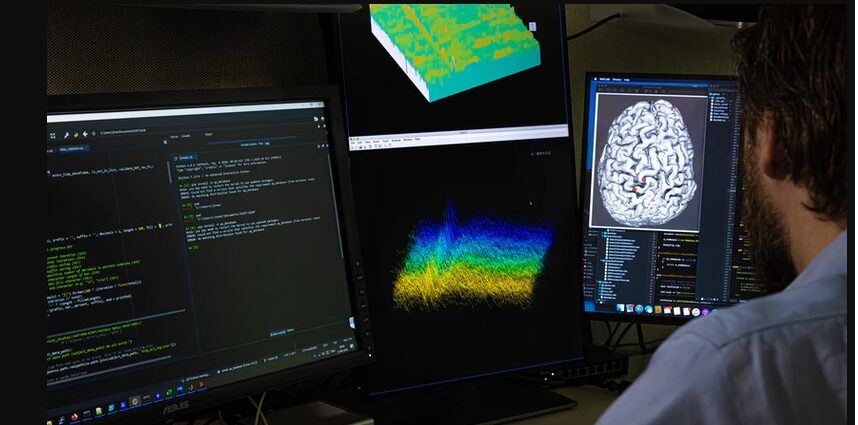

Il partecipante, che vive a casa con la sua famiglia, ha imparato a generare attività cerebrale tentando diversi movimenti. Questi segnali cerebrali vengono raccolti dai microelettrodi impiantati e decodificati da un modello di apprendimento automatico in tempo reale.

Il modello mappa i segnali per significare “sì” o “no”. Per rivelare ciò che il partecipante vuole comunicare, un programma di ortografia legge ad alta voce le lettere dell’alfabeto. Utilizzando il neurofeedback uditivo, il partecipante è in grado di scegliere “sì” o “no” per confermare o rifiutare la lettera, formando alla fine parole e frasi intere.

”Questo studio ha anche dimostrato che, con il coinvolgimento della famiglia o dei caregiver, il sistema può in linea di principio essere utilizzato a casa. Questo è un passo importante per le persone che vivono con la SLA che vengono curate al di fuori dell’ambiente ospedaliero “, ha affermato il CTO del Wyss Center Giorgio Kouvas.

Il team sta anche lavorando su ABILITY, un dispositivo BCI impiantabile wireless progettato per connettersi in modo flessibile a microelettrodi. Ciò consentirà il rilevamento e l’elaborazione di segnali provenienti da aree altamente specifiche o più grandi del cervello. L’approccio potrebbe consentire la decodifica del parlato direttamente dal cervello durante il discorso immaginato che porta a una comunicazione più naturale.